「AIはAGI(汎用人工知能)と呼ぶにふさわしいほどに十分に賢くなったのではないか」「いや、まだAGIではない」――。

双方の意見は対立したままだ。果たしてAIはAGIに達したのだろうか。2026年初頭のAIの現状と、今年の方向性を占ってみたい。

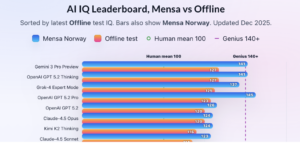

IQテストでは「天才」レベルに達したAI

まず、現在の基盤モデルがどこまで来ているのかを確認しよう。

人間向けIQテストをLLM向けに翻訳・再構成し、正答率を人間のIQ尺度で表現した「AI IQ Test 2025」では、GPT-5.2 ProがIQ142という、いわゆる天才レベルのスコアを記録した。

メンサ基準(IQ130以上)を明確に超えており、「知的能力そのもの」はすでに人間の上位層に並んだ、あるいは超えたと言ってよい。

ここで重要なのは、AIが賢くなったかどうかという問いに対しては、データ上「YES」と答えざるを得ない段階に来ている点だ。

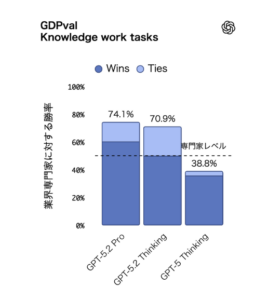

GDPvalが示した「仕事ができるAI」

もう一つ、より実務に近い評価指標が「GDPval」だ。

これは米国GDPに大きく寄与する9産業・44職種を対象に、営業資料、会計スプレッドシート、救急診療スケジュール、製造図面、短編動画など、実際の成果物を作らせて評価するベンチマークである。

GPT-5.2 Proは、このGDPvalにおいて約74%の知識労働タスクで「専門家と同等、あるいは専門家より好まれる」という評価を得た。

ただし、対象となっているのは、業務範囲が明確に定義されたタスクのみ。新規プロダクトの構想や、複雑でオープンエンドなチーム協働型の仕事は含まれていない。したがって全てのホワイトカラーの仕事をAIが代替できるわけではないが、業務委託やリモートワーカーの1時間分程度の仕事はAIに任せることができるようになったと、OpenAIのSam Altman氏は指摘している。

それでもAGIかどうかで揉め続ける理由

では、なぜ「AGIに到達したかどうか」で議論が終わらないのか。

理由は大きく2つある。

理由① 知能の定義が2つある

AI研究の黎明期から、知能の定義には2つの系譜がある。

- マーヴィン・ミンスキー

「人間が行うタスクを機械で実行できるようにする」

→ タスク達成能力重視 - ジョン・マッカーシー

「あらかじめ用意されていない新しい問題を解決できるようにする」

→ 汎化・学習能力重視

OpenAIのAGIの定義は「経済的価値のある仕事のほとんどができる」というもの。明らかに前者(ミンスキー的)だ。なのでOpenAIは、すでにAGIフェーズに入ったと主張しているわけだ。

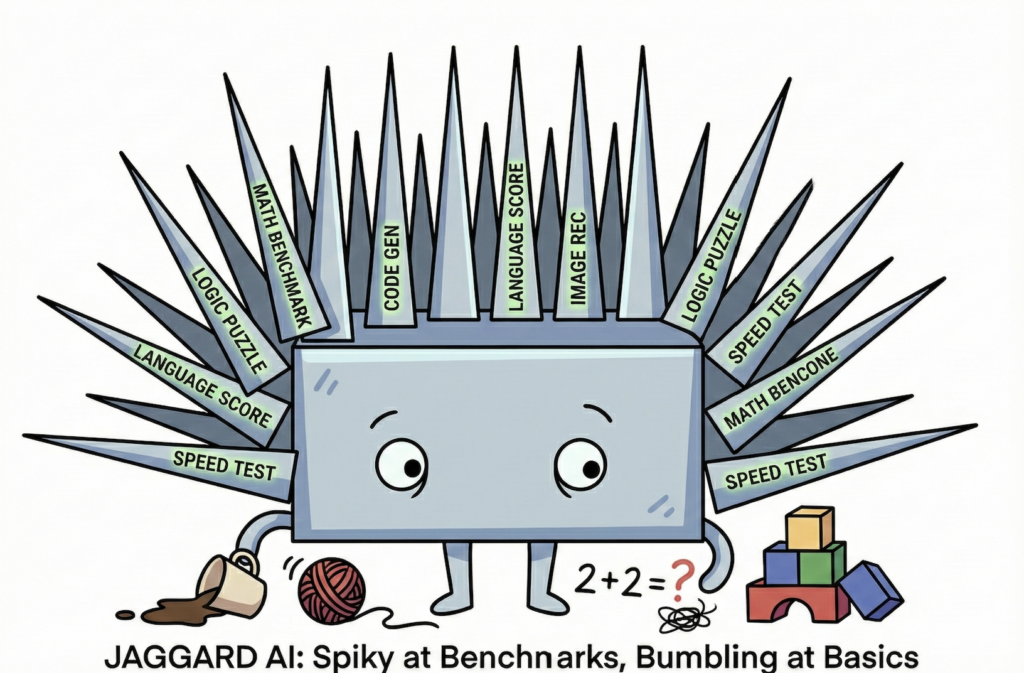

一方で、「未知の状況でも壊れずに学び続けられるか」という後者の定義に立てば、話はまったく変わってくる。

理由② OpenAIとMicrosoftの契約構造

AGI論争には、純粋な学術議論を超えた現実的な事情も絡んでいる。

OpenAIは、設立当初からMicrosoftの支援を受けており、その見返りにAGI到達、もしくは2032年まで、売上の15%をMicrosoftに支払う契約を結んでいる。

そのため、「いつ、どの時点でAGIと見なすのか」は、両社にとって極めて重要な問題になっている。Sam Altman氏が「もうAGIのフェーズに入っている」と語る一方で、MicrosoftのSatya Nadella氏は「今のAIは尖って凸凹の知性であり、AGIには到達していない」と繰り返し強調する。

AGI論争が終わらない背景には、こうした契約と経済的利害も確実に存在している。

「賢いのに使いこなせていない」オーバーハング問題

では現場ではどうか。ホワイトカラーの多くは、AGIを実感できているのだろうか。

Sam Altman氏は「いろいろな分野の専門家たちが、『これは驚くようなことができる』『実際に貢献している』『仕事をより効果的にしている』と言っている」と指摘し、「もうAGIに到達したということでいいのではないか」と語っている。

一方で、Altman氏は多くのビジネスマンがAGIを実感できていないという現状も認識しているようだ。同氏によるとAIの能力が向上しているにもかかわらず、企業や組織の活用レベルがそれに追いついていないというのだ。同氏はこの状況を「オーバーハング(能力の未活用)」と呼ぶ。これは数年前に想定したものと全く異なる展開だと言う。

同氏によると、プログラマーなど生産性が飛躍的に向上した職種がある一方で、1年前のAIの使い方と同じ使い方しかできていない人が多く存在するという。急速な生産性の向上で大きく伸びる企業や業種と、ほとんど変化しない企業や業種。この二極化が「世界に奇妙な結果をいくつももたらすことになる」と同氏は語っている。奇妙な結果とはどういうことを指しているのだろうか。国家間、地域間、企業間の格差の拡大や、人々の所得の格差の拡大のことを指しているのだろうか。

問題はAIではなく「使う側の設計」

では1年前のAIの使い方とは違う、今日のあるべきAIの使い方とはどういうものになるのだろうか。

OpenAIのプラットホーム部門のエンジニアリング担当のHerwin Wu氏は、1年前はプロンプト(命令文)をどう工夫するのかが重要だった。その工夫の仕方は「プロンプトエンジニアリング」と呼ばれた。今は「RAGや、マルチツールコール、データフェッチ、コード実行、画像や動画、複数モデル切替、メモリ管理を、どの順序で、どの制約で、どの論理で使わせるかが最重要になっている」とWu氏は語っている。そうした工夫はプロンプトエンジニアリングではなく、コンテキストエンジニアリングと呼ばれるようになっているのだという。

こうしたコンテキストエンジニアリングができる企業と、そうでない企業との間で生産性の差が大きく開く傾向にあるという。

またAI業界の伝説的エンジニアの一人、Andrej Karpathy氏は、AIをベースにしたアプリやツール、サービスを開発する場合は、コンテキストエンジニアリングに加えて、次のようなことに気をつけたり、機能を実装すべきだと言っている。

- 複数のLLM呼び出しを、ますます複雑化するDAG(有向非巡回グラフ)として裏側で組み合わせ、性能とコストのトレードオフを慎重に調整する

- 人間が介在することを前提にした、アプリケーション特化型のGUIを提供する

- 「自律性スライダー(autonomy slider)」を提供する

つまり、いま求められているのは基盤モデルがさらに賢くなることではなく、使う側の工夫だと言うわけだ。

それでも足りない、最後のピース「継続学習」

とは言うものの、AIはさらに進化しようとしている。Sam Altman氏も「今のAIには1つ欠けている能力がある」と言う。それは「今日はできなかったことを自分で認識し、学び、翌日にはできるようになって戻ってくるという、継続的な自己学習能力だ」としている。同氏は「幼児ができるような、こうした継続的な学習能力は、私たちがこれから作る必要のある重要な要素の一つだと思います」と語っている。

この「継続学習能力」をAIはいつ身につけることができるのだろうか。X(旧twitter)上の研究者たちの投稿を見ていると、継続学習が実現の時期が迫っている気配を感じることができる。

AI研究者のParas Chopra氏は、「継続学習が次のBig Thingだ」と投稿。同じくMark Kretschmann氏は「2025年はエージェントの年。2026年は継続学習の年」と投稿している。Google DeepMindの研究者のVarun Mohan氏は「2026年はエクサイティングな年になる。我々は、継続学習で大きく前進する」と投稿している。

OpenAIの元チーフサイエンティストでAI業界の伝説的エンジニアの一人、Ilya Sutskever氏は、人気ポッドキャストDwarkesh Patelに登壇し、継続学習の現状や社会への影響について1時間以上も語っている。

その中でSutskever氏は継続学習能力を「新しい経験・データ・環境変化を取り込みながら、過去に学んだことを壊さず、判断や行動を更新し続ける能力」と定義している。

これが今のAIに最も必要な能力で、継続学習ができるようになったAIをいろいろな領域に投入すれば、AIはその領域に必要なスキルや知識を次々と学習して賢くなっていくという。そしてそれぞれの領域で賢くなったAIが統合されれば、どんな領域のことにも詳しい超知能が完成するとしている。

同氏は、継続学習の実現は十分に可能で、実現のためのアイデアもある、と語っている。

2026年、その先へ

2026年、まずは今のAIを活用することが最大の課題。活用できるかどうかは、AI開発企業側ではなく、AIのユーザー企業側の取り組みにかかっている。活用できた企業は、今年が大きな飛躍の年になることだろう。

そして継続学習が今年中に実装されれば、AIは今年、さらに次のステージに進むことになる。AGIが実現したかどうかの議論はさておき、産業界の変化は加速する一方だ。

湯川鶴章

AI新聞編集長

AI新聞編集長。米カリフォルニア州立大学サンフランシスコ校経済学部卒業。サンフランシスコの地元紙記者を経て、時事通信社米国法人に入社。シリコンバレーの黎明期から米国のハイテク産業を中心に取材を続ける。通算20年間の米国生活を終え2000年5月に帰国。時事通信編集委員を経て2010年独立。2017年12月から現職。主な著書に『人工知能、ロボット、人の心。』(2015年)、『次世代マーケティングプラットフォーム』(2007年)、『ネットは新聞を殺すのか』(2003年)などがある。趣味はヨガと瞑想。妻が美人なのが自慢。