生成AIがコードを書くこと自体は、もはや驚きではなくなった。だが米OpenAIがいま示しているのは、その次の段階だ。勝負どころは、AIにコードを書かせることではない。AIが安定して働ける開発環境そのものを設計し、学習し、改善し続けることにある。OpenAIのテクニカルスタッフであるRyan Lopopolo氏はこの考え方を「ハーネスエンジニアリング」と呼ぶ。

よく似た言葉に、プロンプトエンジニアリング、コンテキストエンジニアリングという表現がある。プロンプトエンジニアリングとは、AIモデルへの指示文(プロンプト)をいかに巧みに書くかという技術で、2024年ごろに広く普及した。コンテキストエンジニアリングは2025年に台頭した概念で、単一のプロンプトでは不十分だという認識から生まれた。関連文書、会話履歴、ツール定義、検索結果などその都度必要な情報をコンテキスト・ウィンドウへ組み込み、モデルが「何を知っているか」を設計する営みだ。

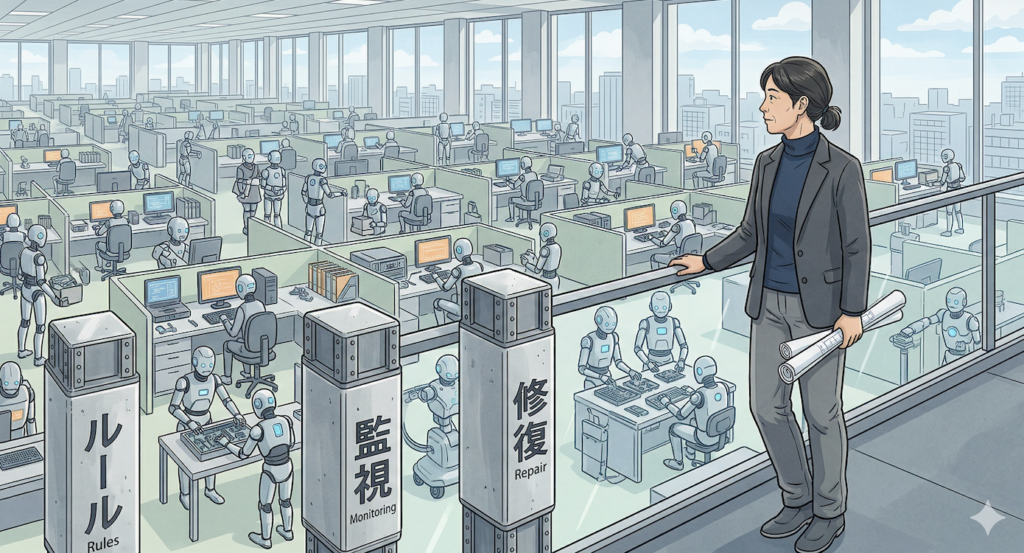

ハーネスエンジニアリングはこの両者をさらに上位から包含する。プロンプトエンジニアリングが「メールの文面を磨く」作業だとすれば、コンテキストエンジニアリングは「メールに必要な添付ファイルを選ぶ」作業だ。ハーネスエンジニアリングはその先を目指す――「オフィスそのものを設計する」営みと言っていい。端的に言えば、コンテキストエンジニアリングまでは「AIに何を入力するか」の設計だった。ハーネスエンジニアリングはその先を行く。「AIが間違えたときどう止めるか」「品質をどう測るか」「問題が起きたらどう自動修復するか」まで、AIが働く職場のルールと仕組みごと設計する。

Lopopolo氏が2026年2月11日に公開したOpenAI公式ブログによると、同社チームはこの5カ月間、手書きコードを1行も使わずに社内向けベータ製品を構築し、運用してきた。アプリの基本動作だけでなく、テスト、自動テスト・ビルドの設定、ドキュメント、システム監視、内部ツールまでCodexが書いた。少人数チームで100万行規模のコードを生み出し、実際に社内ユーザーが日常的に使う製品として稼働させた。

ここで本当に重要なのは、AIが優秀になったという話ではない。エンジニアの仕事の重心が変わったことだ。Lopopolo氏は、チームの主な仕事が「コードを書くこと」から、「環境を設計し、意図を明確にし、改善の仕組みを作ること」へ移ったと書く。初期に遅かった理由も、モデルの能力不足というより、エージェントが働くための道具や仕組みの整理、内部構造が足りなかったからだ。つまりAI時代の生産性は、モデル性能だけではなく、AIが迷わず働ける足場をどれだけ整えられるかで決まる。Lopopolo氏自身、その感覚を「500人規模の組織をまとめる技術責任者のようなものだ」と表現した。個々のコードの細部に口を出す立場ではなくなった、という意味だ。

その足場作りの中核にあるのが「AIが読み解きやすい構造」だ。OpenAIは、知識の置き場をGoogle DocsやSlackや人の頭の中に残さず、コード保管庫内の文書や設計資料に寄せる方針を取った。長大な指示書を一枚置くのではなく、短い目次ファイル「AGENTS.md」(約100行)を入口として使い、体系化された資料フォルダ「docs/」を唯一の情報源とした。設計思想、実行計画、技術的な課題の積み残し、品質評価までをAIが参照できる形で保存する。人間にとっての「新人が理解しやすいコード全体」を、AI向けに徹底した形だ。

OpenAIはさらに、稼働記録、数値データ、処理の追跡情報をシステム監視の仕組みを通じてCodexに参照させることで、不具合の再現から修正、性能確認までを一貫した流れで処理できるようにした。米国の人気AIポッドキャスト「Latent Space」に登壇した同氏は、インタビューの中で、プログラムの動作確認は1分以内に収めることを鉄則にしていると語った。時間がかかりすぎる場合はその場で作業を細かく分解し直す。AI中心の開発では、コードを書く速さ以上に、試して直すサイクルの速さが勝負を決める。

この考え方はレビューの哲学まで変える。承認の手続きを最小限に絞り、修正は次の作業の中で素早く反映する。コードを本番環境へ反映する前の厳しい人間レビューではなく、反映後に代表サンプルを確認し、そこで見えたミスのパターンをドキュメントやテスト、レビュー担当のAIエージェントに書き戻すという改善サイクルが回る。人が消えるのではない。役割が変わるのだ。

Lopopolo氏はこの実験の本質を一文に凝縮している。「エージェントは難しくない。難しいのはハーネスだ(Agents aren’t hard; the Harness is hard)」。

この話が単なる開発現場の工夫で終わらないのは、OpenAIが2026年2月5日に発表した企業向け基盤「Frontier」とつながっているからだ。Lopopolo氏自身、Frontierを「企業向けのAIエージェント運用基盤」と位置づけ、そのチームで新製品開発を担うと説明している。つまり今回の内部実験は、企業がエージェントを組織に組み込む際の先行事例でもある。Frontierの公式発表も、企業導入の最大の障壁は「モデルの知能」ではなく「エージェントを組織内でどう構築し運用するか」だと明言している。

日本企業にとってこの示唆は重い。日本企業の多くは会議でのみ共有される判断基準、ベテランしか知らない運用の勘所、属人的なレビュー観点を抱えたままだ。ドキュメント文化が根付いていない組織では、AIはその知識に触れることができず、賢くなりようがない。逆に言えば、評価軸、監視、権限、運用ルールまでをAI前提で再設計できる企業は、一気に加速する可能性がある。これから強い企業は、AIを使う企業ではない。AIが働ける職場を作れる企業だ。

主な情報源

- Harness engineering: leveraging Codex in an agent-first world | OpenAI(2026年2月11日)

- Introducing OpenAI Frontier | OpenAI(2026年2月5日)

- Extreme Harness Engineering for Token Billionaires | Latent Space(2026年4月7日)

湯川鶴章

AI新聞編集長

AI新聞編集長。米カリフォルニア州立大学サンフランシスコ校経済学部卒業。サンフランシスコの地元紙記者を経て、時事通信社米国法人に入社。シリコンバレーの黎明期から米国のハイテク産業を中心に取材を続ける。通算20年間の米国生活を終え2000年5月に帰国。時事通信編集委員を経て2010年独立。2017年12月から現職。主な著書に『人工知能、ロボット、人の心。』(2015年)、『次世代マーケティングプラットフォーム』(2007年)、『ネットは新聞を殺すのか』(2003年)などがある。趣味はヨガと瞑想。妻が美人なのが自慢。