ChatGPT周辺技術の進化の速度が半端ない。課題とみなされていたことが次々と解決され、チャット型AIが自律エージェントというまったく別のツールへと進化してきた。幾つか登場したばかりの自律エージェントの特徴を見てみたい。

ChatGPTは、いわば「何でも知っている物知りな部下」のような存在。何を聞いても、すぐに答えてくれるし、簡潔に要点をまとめるところもすばらしい。ただ間違った情報が混じることがある。「知ったかぶりして、シラッと嘘をつく」ような感じだ。

この問題を解決するために、ChatGPTの開発元である米OpenAIは、ChatGPT pluginという仕組みを発表してきた。外部のプログラムやデータベースに接続する仕組みで、より正確な情報を外部から調達することでChatGPTの回答に誤りが少なくなる。例えると、部下が資料室に行って、資料に目を通してから答えるようになった感じだ。

ただこの部下の記憶容量には限界がある。いろいろな資料に目を通しているうちに、何を探していたのか分からなくなる。なので上司から資料室のどの資料に目を通すべきかを指示してあげなければならない。

そこに、重要なことを長く記憶できるAutoGPTと呼ばれる技術が登場した。いろんな作業をしていても、その作業の目的を忘れない。なので目的を伝えるだけで、自分で何をすべきか判断し、すべきことを1つ1つこなしていくことで目的に近づくことができる。

例えると、「仕事を任すことのできる部下」のような感じだ。上司が細かく指示しなくても、この部下は自分で何をすべきか判断し実行する。ときには同僚とチームを組んで、手分けしながら目的を達成することもある。

ChatGPTがリリースされたのが2022年11月30日。ChatGPT Pluginが2023年3月23日、Auto GPTは3月30日だ。わずか数ヶ月で「物知りな部下」から「仕事を任せることのできる部下」に一気に進化したわけだ。

「仕事を任せることのできる部下」自律エージェントには、どんなものがあるのだろう。詳しく見ていこう。

自律エージェントには、単独エージェント型と複数エージェント型がある。それぞれの特徴を見ていこう。

▼単独エージェント型

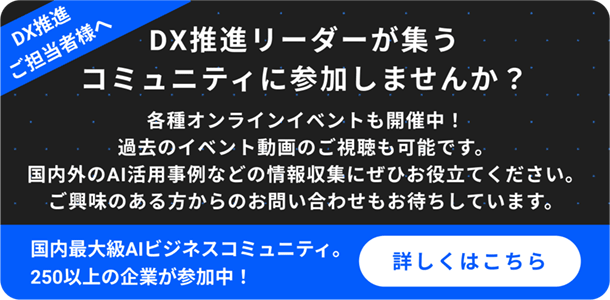

単独エージェントとしてはAutoGPTがその代表例。短期と長期のメモリと検索機能、GPT3.5やGPT4を利用して、自らタスクを考えて実行する。詳しくは、「AutoGPTは何がすごいのか 実際に非エンジニアが記者ボットを自作してみた」という記事に書いたが、「新技術に関する原稿を書きたいので、ネットを検索して最初の技術動向を調べて」と命令すると、TwitterやYouTubeから最初技術の動向を調べて報告してくれた。

https://agentgpt.reworkd.ai/

しかも「新技術に関するインフルエンサーを探す」「新技術に関するユーザーの感情分析」など、自分では思いつかないようなタスクを次々と勝手に考えついては勝手に実行。自分で性能のいいAIにあっという間に進化していった。

AutoGPT登場の衝撃は大きく、3月30日に登場後まもなくTwitterのトレンドワード1位になったほか、開発者向けのサイトGitHubで10万個以上の星マークがついている。同サイト上でここまで注目を集めたプログラムは珍しいという。

2つ目の単独型自律エージェントの例は、BabyAGIだ。

BabyAGIは、AutoGPT同様に、ユーザーが簡単な指示を出すだけで、その意図をくんでタスクを次々と設定し、次々と実行していく。AutoGPTとの違いは、AutoGPTはタスクを1つ1つ決めて、それを1つ1つ実行していくが、BabyAGIは最初に幾つかのタスクを1つのタスクセットとして決めて、それを実行。1つのタスクセットを実行し終わってから、次に何をするのかを決めるやり方。この方法だと、より複雑な目的に向いているとみられている。

このBabyAGI、実は元マイクロソフトの伝説のエンジニアと呼ばれる中島聡氏の長男で、シアトル在住のベンチャーキャピタリスト中島洋平氏が開発した。BabyAGIのコードがAutoGPTのそれに比べて簡潔なので、多くの開発者が利用し、既に派生プログラムが多数生まれている。米誌Fortuneは「BabyAGI is taking Silicon Valley by storm(BabyAGIがシリコンバレーで旋風を巻き起こしている)」と絶賛している。

▼複数エージェント型

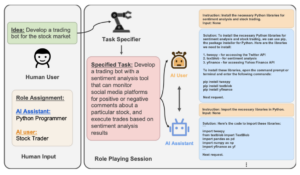

一方複数エージェント型の代表例はCAMEL。Communicative Agents for “Mind” exploration of Large Scale Language Model Societyの略で、自律エージェントを2体作り、2体の間で対話しながら作業を進めていくというもの。

Communicative Agents for “Mind” exploration of Large Scale Language Model Society P4

論文の中の応用例では、人間が「株売買ボットを開発する」という目的を設定し、一つのAIエージェントをトレーダー、もう1つのAIエージェントをプログラマーに設定。2つのエージェントが対話しながら、ボットの開発を進めていく様子が描写されている。1つのエージェントにプログラミングを任せれば、人間がその進展具合や性能を確認していく必要があるが、CAMELだともう1つのエージェントがその役割を果たしてくれるようになるようだ。

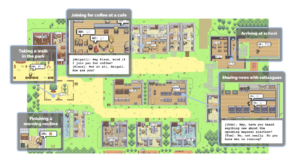

複数エージェント型のもう1つの例は、一部で「Westworldシミュレーション」と呼ばれる研究だ。Stanford大学とGoogleの共同研究として、4/7にGenerative Agents: Interactive Simulacra of Human Behaviorというタイトルの論文が発表されている。

Generative Agents: Interactive Simulacra of Human Behavior p1

論文によると、25体のAIエージェントに性格や記憶を与え、相互に交流させる実験を行ったところ、それぞれのAIエージェントは公園の中を自由に歩き回り、カフェでお茶し、仲間と世間話をしたりした。そんな中、一人のエージェントにパーティーを企画させたところ、その話が全員に伝わり、相手を見つけてデートを申し込み、一緒にパーティーに参加するなどのエージェントも出たという。

米国では、複数のAIが住む仮想現実の環境の中に人間が迷い込むという内容のテレビドラマWestworldが人気らしいが、この実験はまさにそんな環境を作り出すことに成功した実験と言える。

こうしたAIエージェントが作り出す環境は、ゲームやメンタルケア、外国語学習などに応用されるものと見られている。

今回紹介した自律エージェントは、どれもまだ発展途上。さらなる技術革新が必要なものが多いが、AIの研究開発が自律エージェントの方向に進むことはほぼ間違いない。ビジネスにおける生産性が大きく伸びる一方で、雇用にも大きな影響を与えることになるだろう。

湯川鶴章

AI新聞編集長

AI新聞編集長。米カリフォルニア州立大学サンフランシスコ校経済学部卒業。サンフランシスコの地元紙記者を経て、時事通信社米国法人に入社。シリコンバレーの黎明期から米国のハイテク産業を中心に取材を続ける。通算20年間の米国生活を終え2000年5月に帰国。時事通信編集委員を経て2010年独立。2017年12月から現職。主な著書に『人工知能、ロボット、人の心。』(2015年)、『次世代マーケティングプラットフォーム』(2007年)、『ネットは新聞を殺すのか』(2003年)などがある。趣味はヨガと瞑想。妻が美人なのが自慢。