今日、AIがここまで注目されるようになったのは、当時トロント大学教授だったGeoffrey Hinton先生のDeep Learningの論文がきっかけだったし、中でも畳み込みニューラルネットワーク( convolutional neural networks =CNN) が人間の目を超える精度で、写真の中に何が写っているのかを判別できるようになったことも大きかったと思う。自動走行車が世界を変えそうな勢いなんだけど、自動走行車が真剣に検討されるようになったのも、CNNが人間の目を超える精度を上げたからなんだよね。

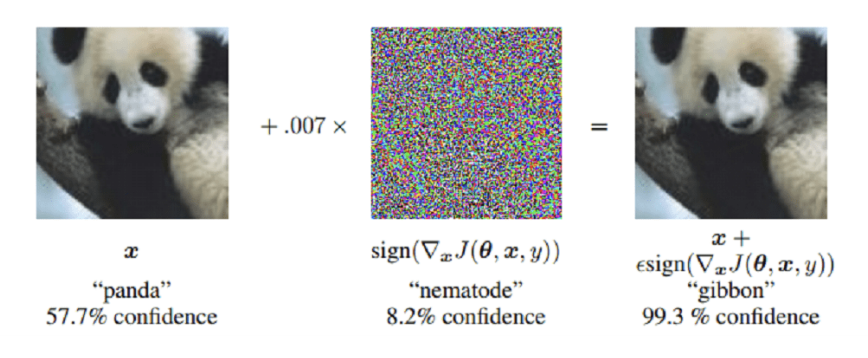

でもCNNには弱点があることが分かっていて、人間の目には分からないようなちょっとしたノイズを写真に追加すると、CNNはまったく別物として認識してしまう。2015年の論文の中に紹介されている例では、パンダが写ってる写真にちょっとしたノイズを追加したら、CNNは自信いっぱい(自信レベル99.3%)に「テナガザル」と答えている。もしハッカーがノイズを送りつけることに成功したら、自動走行車が判断を誤って事故を起こす可能性だってあるわけだ。

そこでこのCNNの問題点を解決できるニューラルネットワーク「capsule networks」をヒントン氏が考案し、論文で発表した。論文はまだレビュー待ちなんだけど、関係者の間では大きな話題になっているもよう。

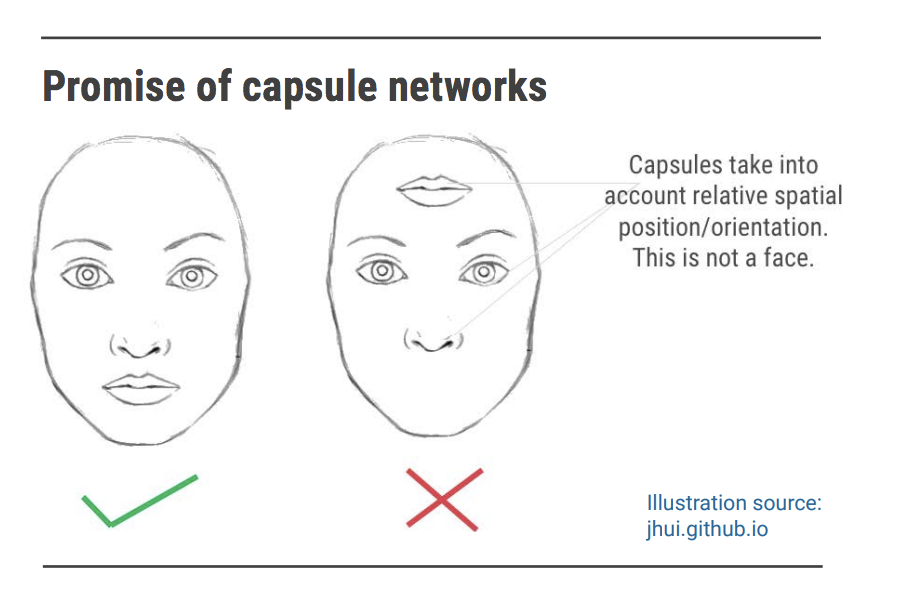

今までのCNNなら、「口」が「おでこ」にあっても「顔」と認識していたけど、capsule networksなら「口」の位置が正しくなければ「顔」と認識しないのだとか。

湯川鶴章

AI新聞編集長

AI新聞編集長。米カリフォルニア州立大学サンフランシスコ校経済学部卒業。サンフランシスコの地元紙記者を経て、時事通信社米国法人に入社。シリコンバレーの黎明期から米国のハイテク産業を中心に取材を続ける。通算20年間の米国生活を終え2000年5月に帰国。時事通信編集委員を経て2010年独立。2017年12月から現職。主な著書に『人工知能、ロボット、人の心。』(2015年)、『次世代マーケティングプラットフォーム』(2007年)、『ネットは新聞を殺すのか』(2003年)などがある。趣味はヨガと瞑想。妻が美人なのが自慢。